L’IA generativa (GAI) permette di creare output, come testi, foto e video, assottigliando il confine tra realtà e virtualità, secondo ritmi e finalità stabiliti da un utente in prima persona, che può differire dal soggetto riprodotto nell’opera.

A livello internazionale, le autorità stanno introducendo nuove norme per garantire un ambiente rispettoso delle identità (micro) e delle comunità (macro) sulle piattaforme digitali. Ma a risultare troppo spesso assente è la trasmigrazione del concetto di consenso. Inquadrato nel tech come il “diritto a essere informati”, il consenso è un’autorizzazione (espressa o tacita), un atteggiamento reversibile e cruciale per determinare la forza degli obblighi morali. È un atto politico di autodeterminazione del corpo.

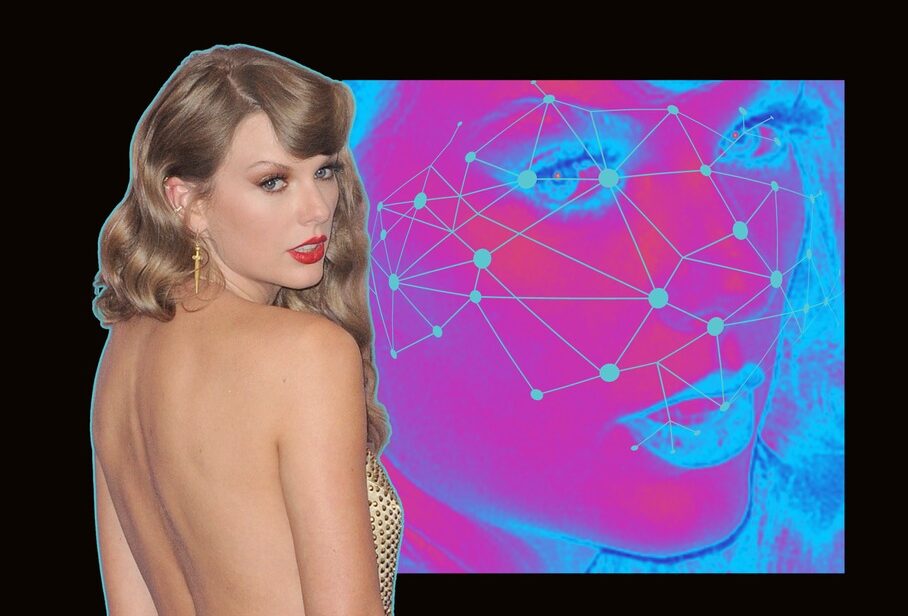

La proliferazione di contenuti deepfake ha accresciuto l’incertezza ed esposto le persone a innumerevoli rischi in assenza di avvisi, watermark e disclaimer che chiariscano l’origine dei contenuti. Mentre qualcuno sostiene che sia possibile realizzare etnografie esponendoci in prima persona alla GAI per comprenderne il processo, occorrerebbe ricordare quali sono le principali vittime dell’attribuzione non consensuale da parte di terzi degli attributi personali: il 96% dei deepfake rientrano nella pornografia e nel 99% dei casi ritraggono donne.

L’utilizzo dei deepfake potrebbe imporsi come strategia per delegittimare figure chiave e infliggere discriminazioni razziali e di genere. Alexandria Ocasio-Cortez, Michelle Obama e Giorgia Meloni sono solo alcune delle vittime nel campo della politica.